VerMind

A high-performance language model with GQA support, designed for efficient training and inference at scale.

一个支持 GQA 的高性能语言模型,专为高效训练和大规模推理而设计。

Features

核心功能

Built with modern techniques for optimal performance

采用现代技术构建,实现最佳性能

Grouped Query Attention

分组查询注意力 (GQA)

Efficient attention with grouped query heads for faster inference and reduced memory usage.

通过分组查询头实现高效注意力,加速推理并降低内存占用。

SwiGLU Activation

SwiGLU 激活函数

Swish-Gated Linear Unit for improved model performance and training stability.

Swish 门控线性单元,提升模型性能和训练稳定性。

RoPE with YaRN

RoPE + YaRN 扩展

Rotary Position Embedding with context extension support up to 32K tokens.

旋转位置嵌入,支持高达 32K tokens 的上下文扩展。

vLLM Adapter

vLLM 适配器

High-performance inference with OpenAI-compatible API for production.

高性能推理,提供 OpenAI 兼容 API。

LoRA Fine-Tuning

LoRA 微调

Parameter-efficient fine-tuning, training only 0.1-1% of parameters.

参数高效微调,仅训练 0.1-1% 的参数。

Distributed Training

分布式训练

Built-in DDP support to scale training across multiple GPUs.

内置 DDP 支持,跨多 GPU 扩展训练。

Packed SFT Training

打包式 SFT 训练

Efficient sequence packing with Varlen FlashAttention.

使用 Varlen FlashAttention 的高效序列打包。

DPO / PPO / GRPO

DPO / PPO / GRPO

Multiple alignment methods for human preference optimization.

多种对齐方法,优化人类偏好。

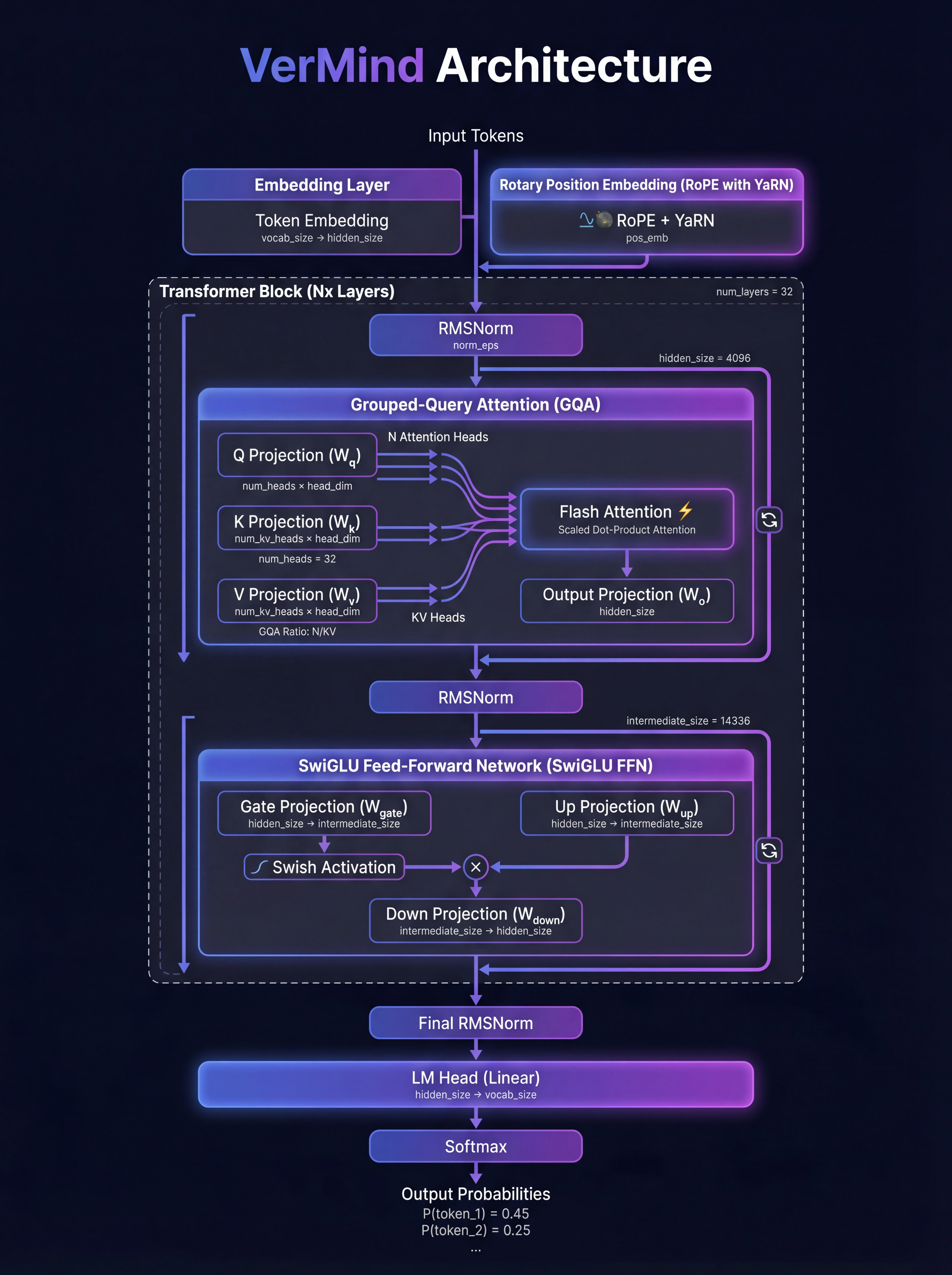

Architecture

架构

State-of-the-art transformer optimized for efficiency

针对效率优化的最先进 Transformer 架构

RMSNorm

Stable training

稳定训练

RoPE

Position embedding

位置嵌入

GQA

Memory efficiency

内存效率

SwiGLU FFN

Better activations

更好的激活

🎯 Interactive Web Demo

🎯 交互式 Web 演示

Try VerMind in your browser with our Gradio interface

通过我们的 Gradio 界面在浏览器中尝试 VerMind

LLM Mode - Pure Text Conversation LLM 模式 - 纯文本对话

python3 scripts/web_demo.py --model_path nev8r/vermind --mode llm

Quick Start

快速开始

Get up and running in minutes

几分钟内启动运行

Clone Repository

克隆仓库

git clone https://github.com/nev8rz/vermind.git

cd vermindInstall Dependencies

安装依赖

pip install -r requirements.txtStart Training

开始训练

bash examples/pretrain.shModel Configurations

模型配置

Available model sizes and specifications

可用的模型大小和规格

| Model | 模型 | Params | 参数量 | Layers | 层数 | Hidden | 隐藏层 | Heads | 注意力头 |

|---|---|---|---|---|---|---|---|---|---|

| VerMind | ~104M | 16 | 768 | 16 |